라즈베리파이에서 LLM 서버 구축 및 질의응답

1. 실습 내용 캡쳐 이미지 (4점)

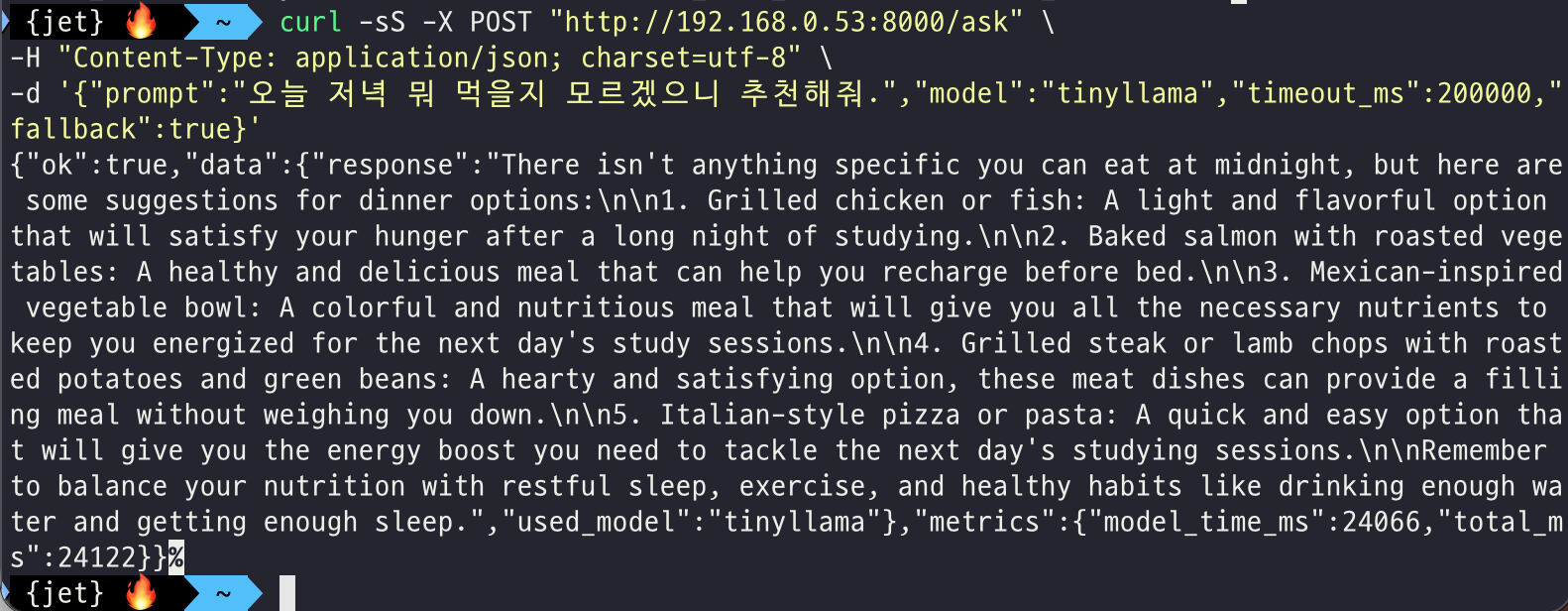

내 PC에서 서버(Raspberry)로 tinyllama로 질문후 답변 받은 내용 (질문내용 자유)

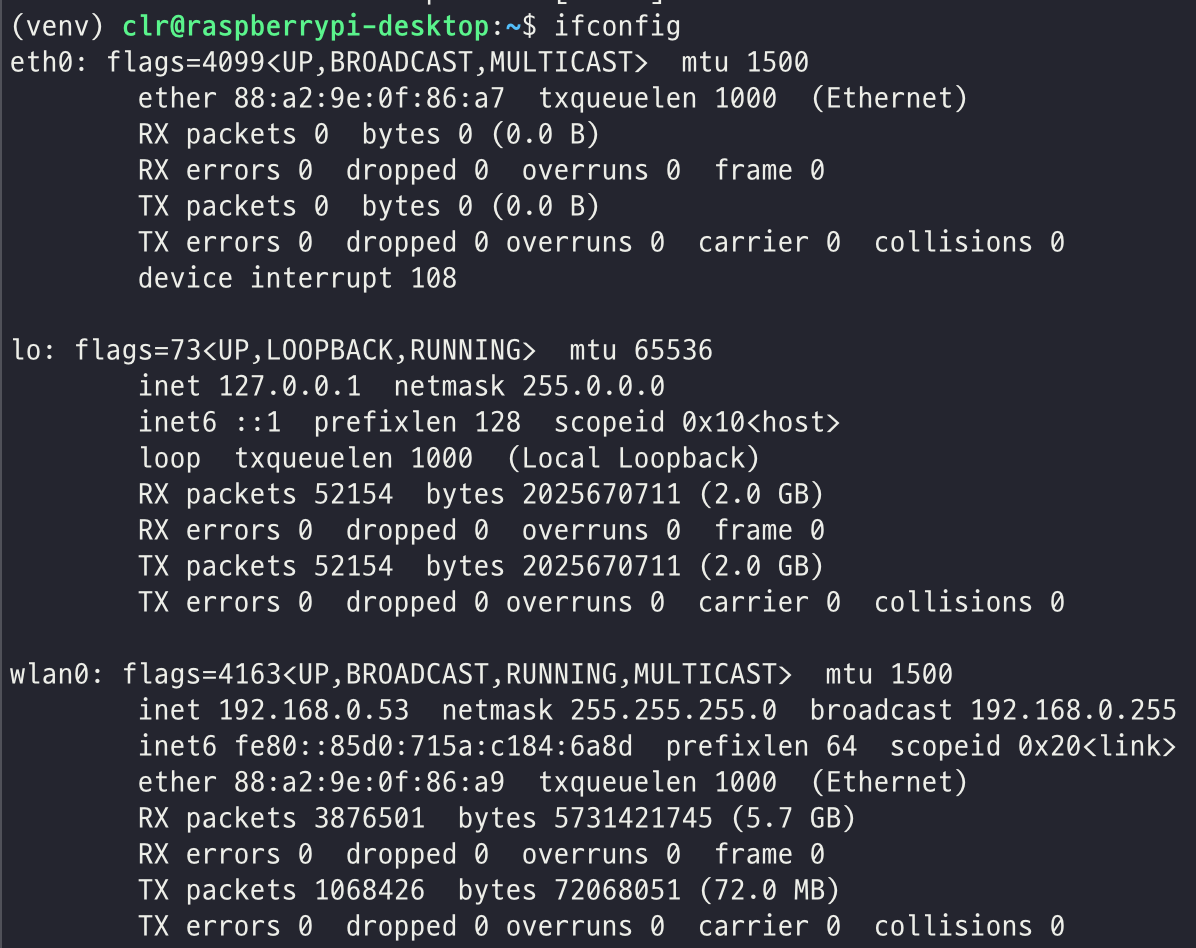

라즈베리파이 서버 ip: 192.168.0.53

질문 내용

curl -sS -X POST "http://192.168.0.53:8000/ask" \

-H "Content-Type: application/json; charset=utf-8" \

-d '{"prompt":"오늘 저녁 뭐 먹을지 모르겠으니 추천해줘.","model":"tinyllama","timeout_ms":200000,"fallback":true}'

요청 결과

2. 과제 내용 캡쳐 이미지 (6점)

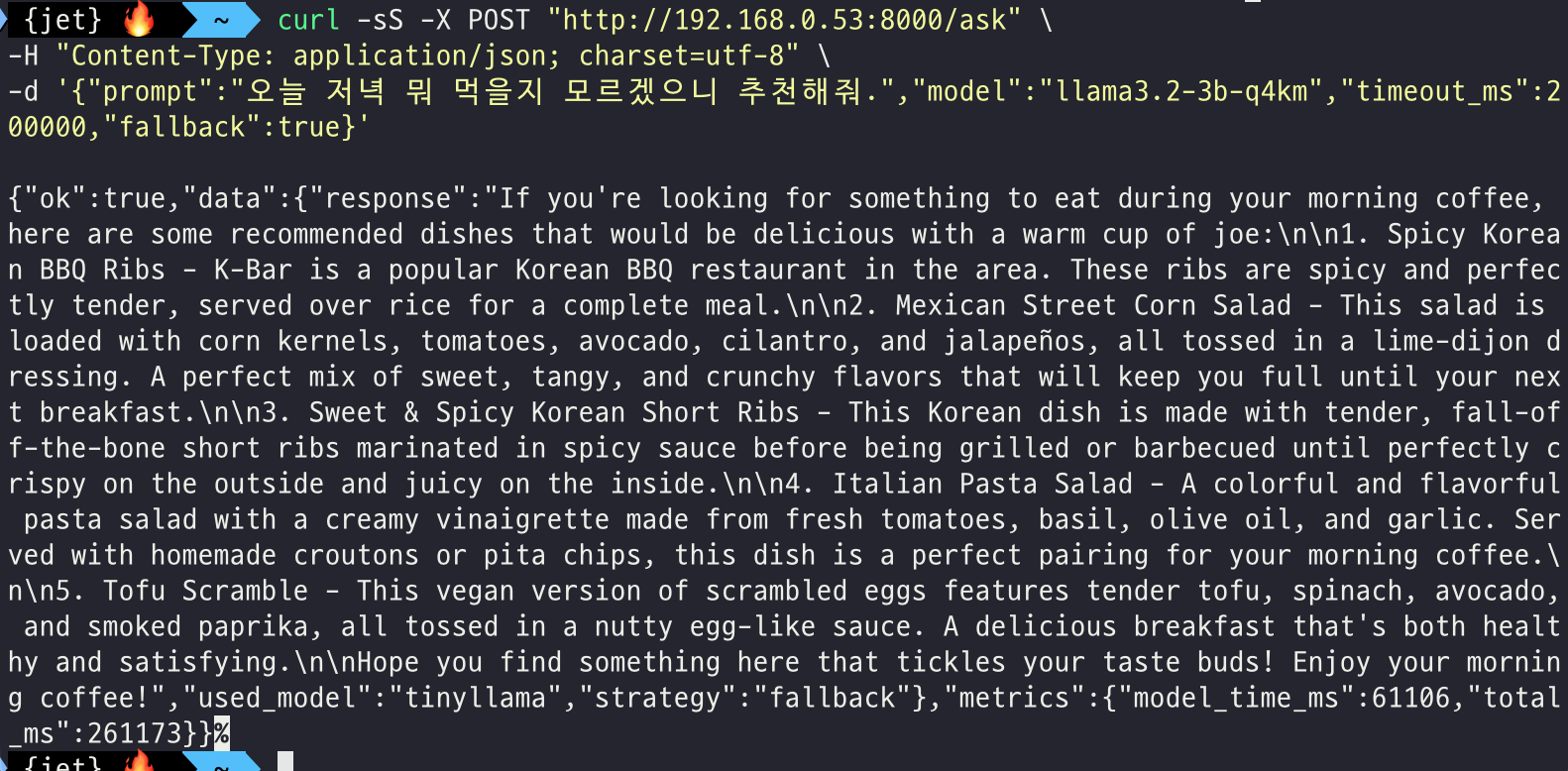

내 PC에서 서버(Raspberry)로 직접 등록한 LLM에 질문후 답변 받은 내용 (질문내용 자유)

1) 질문후 답변내용이 바뀌었다면 간단한 비교

- tinyllama 사용에 비해 요청 후 답변을 받기까지 시간이 오래걸렸다.

- 두 응답의 형식은 비슷했지만 내용 측면에서 Q4_K_M이 한국 음식을 더 추천해줬고, 추천해준 음식이 더 내 입맛에 맞는지라 더 마음에 들었다.

- tinyllama는 음식에 대해 추상적으로 설명하는 느낌인데(~를 위한… 맛있는…) Q4_K_M은 음식과 그 재료 대한 상세한 설명(매콤… 상큼…)이 있어 더 믿음이 갔다.

- 전반적으로 Q4_K_M이 마음에 들었으나, 나는 저녁 메뉴 추천을 부탁했는데 morning coffee와 함께 먹을 것을 찾느냐고 언급하는 부분은 아쉬웠다. tinyllama는 midnight을 언급하며 그래도 저녁이라는 맥락을 챙겨주었다.

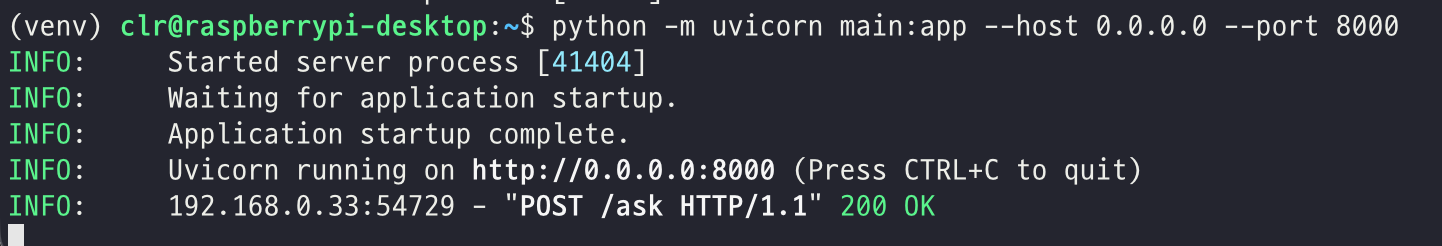

2) 라즈베리 구동서버 화면 이미지(터미널 실행내용 캡쳐!!)

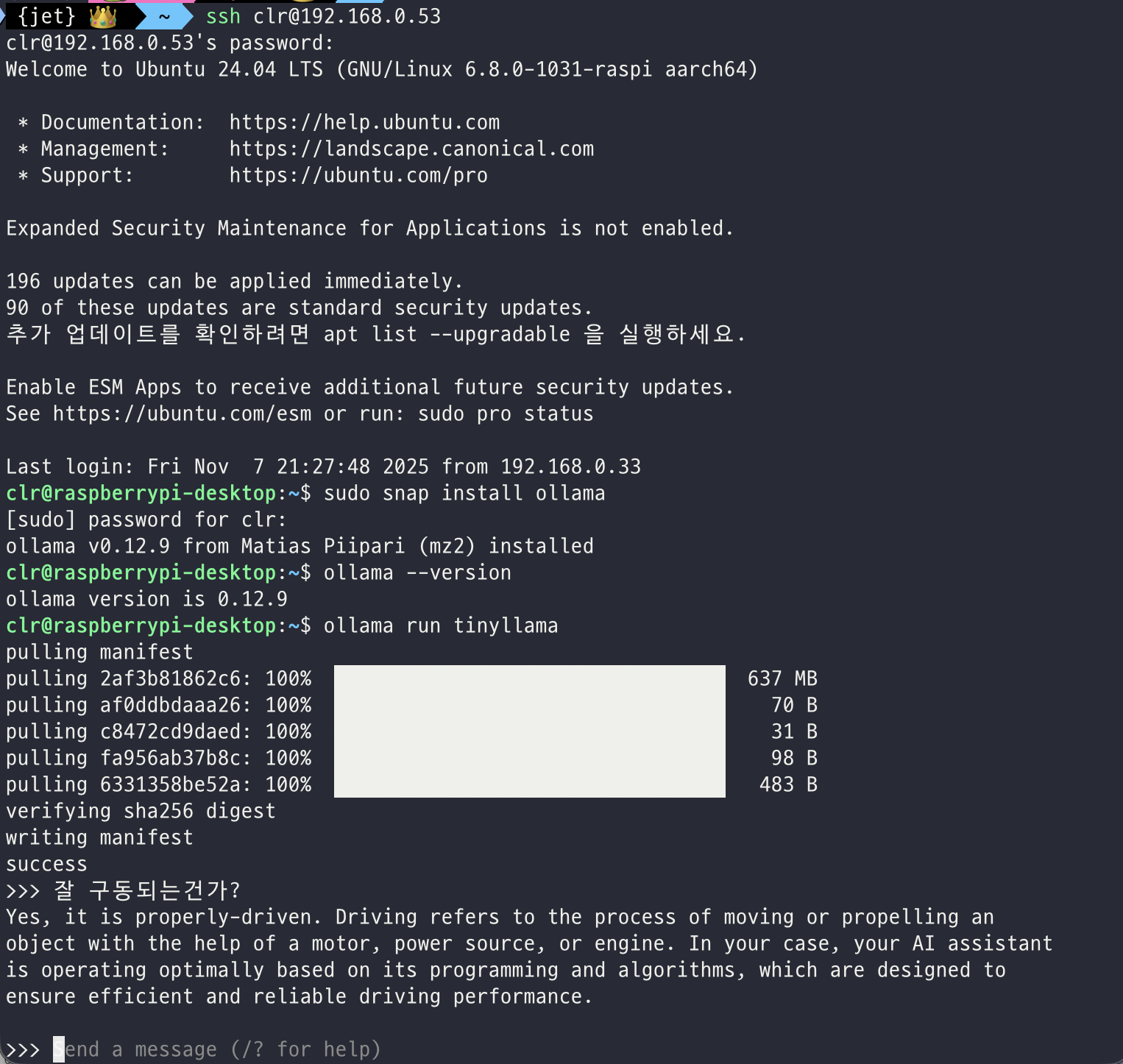

- 실습

ssh로 접속, 라즈베리파이에서 ollama설치 및 tinyllama 실행테스트

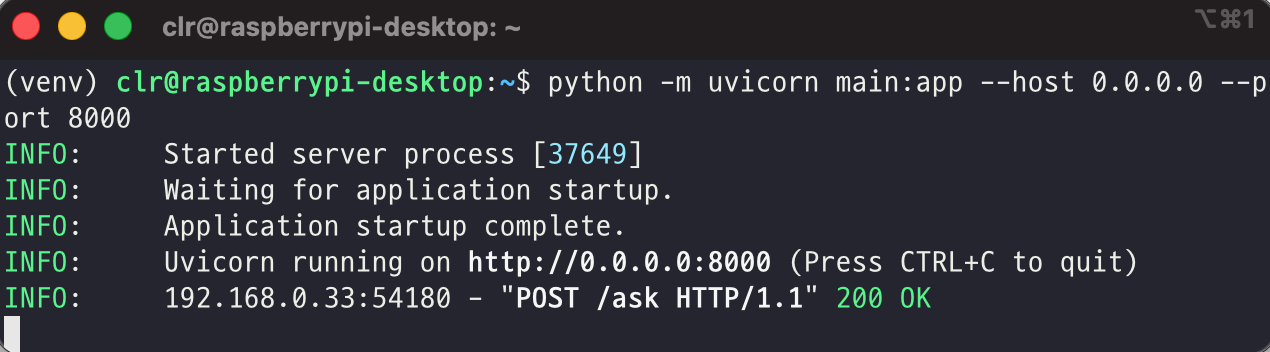

질문 시 서버 로그

- 과제

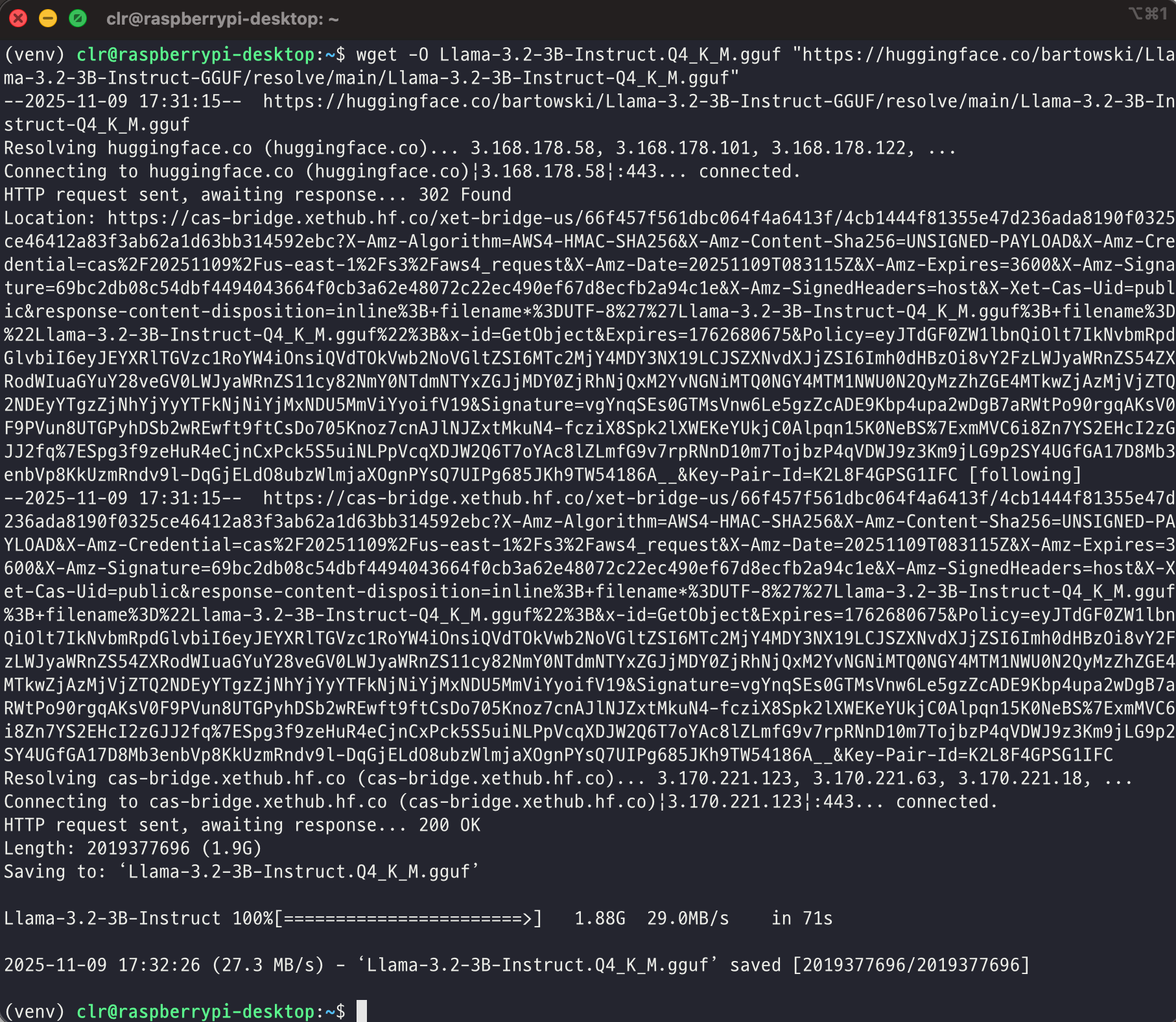

모델 다운로드 (과제 설명과 동일하게 Q4_K_M 사용)

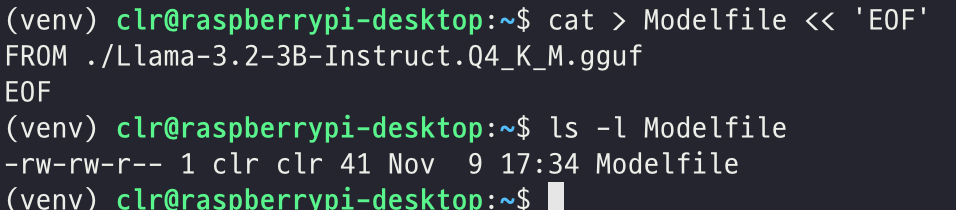

Modelfile 생성 및 확인

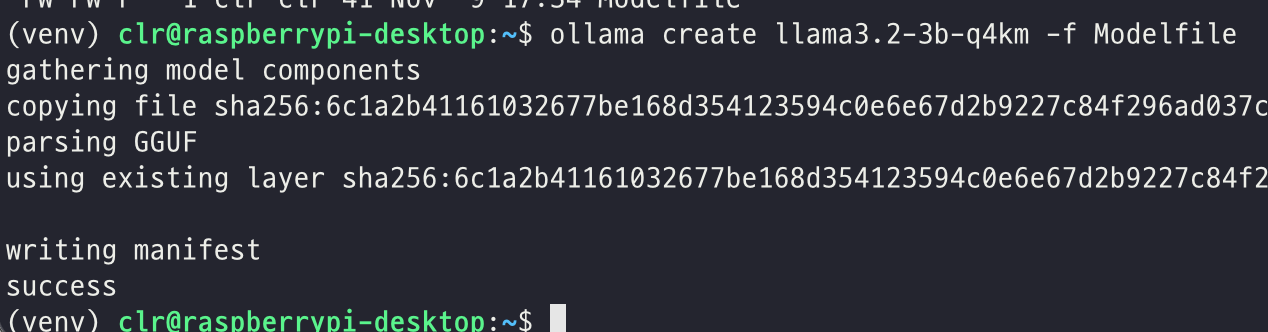

Ollama에 등록

질문 시 서버 로그

Leave a comment